グーグルが音声認識ソフトを開発、組み込み機器と「クラウド」を結合:組み込み開発

Web検索時に、スマートフォンのマイクに検索語を話しかけることで、検索語を認識し、Web検索を実行する。スマートフォンが備えるGPS機能と連携することも可能だ。音声認識率を高めるためにインターネット上のサーバクラスタ(クラウド)に音声データを送信して認識させる手法を採った。

グーグルは2009年12月7日、スマートフォン向けの音声認識ソフトウェア「Google音声検索」を公開した。米Google社が2008年秋から公開していた音声認識ソフトウェアを日本語に対応させたもの。Android向けとiPhone向けの2種類を用意する。

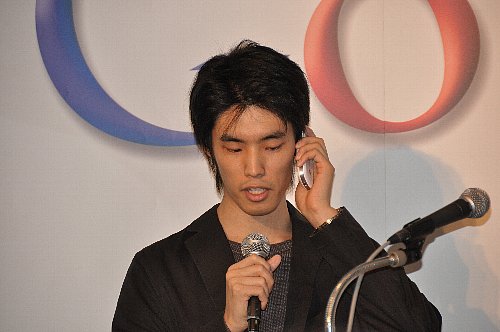

Web検索時に、スマートフォンのマイクに検索語を話しかけることで、検索語を認識し、Web検索を実行する(図1)。スマートフォンが備えるGPS(Global Positioning System)機能と連携することも可能。例えば、利用者が渋谷にいるときに「ラーメン」と話しかけて検索させると、渋谷にあるラーメン店の情報を検索できる(図2)。スマートフォンは必ずしも文字を入力しやすいとは言いにくい。話しかけることで文字入力を可能にするソフトウェアは、ソフトウェア・キーボードの設計や、GUIの構成を大きく変える可能性を持っている。

組み込みでもクラウド

一般に、音声認識機能をスマートフォンのような組み込み機器上で実現しようとすると、機器の構成を大幅に強化しなければならない。音声認識は高性能な機器を要求するものだからだ。

ところが、グーグルは認識率を高めるためにインターネット上のサーバクラスタ(クラウド)に音声データを送信して認識させる手法を採った。サーバ側は音声データを受け取って解析し、その結果をスマートフォンに戻す。スマートフォンはマイクからの音声データをサーバに送って、認識結果を受け取るだけで、複雑なことはしていない。スマートフォンに比べて処理能力がはるかに高く、巨大なデータベースを蓄積できるサーバクラスタを利用することで、音声を高い精度で高速に解析できるようにした。

サーバ側で動作する認識エンジンを作る際に「幅広い年齢層のユーザーから大量の音声サンプルを集め、学習させた。その結果、ほとんどのユーザーの声を認識するエンジンを作れた」(同社アソシエイト プロダクト マネージャーを務める井上陸氏)という。誤認識することもあるが、誤認識結果と、ユーザーが望んでいた結果をユーザーが認識エンジンに送ることで、学習がさらに進む。井上氏は「多くのユーザーに何度も使ってもらうことで、認識エンジンの精度が高まっていく」という。

同社は、検索サービス利用者が入力した検索キーワードや、巡回プログラムが集めたWebページのテキストといった、膨大な言語データベースを持っている。Google音声検索では、この独自の言語データベースも利用する。「音声認識エンジンの解析結果が多少間違えていても、言語データベースを参照して修正できる」(井上氏)。認識エンジンと言語データベースの2段構えで、最終的な結果の精度を上げているのだ。

さらに、日本語化に当たっては文節の区切りを認識して、漢字、ひらがな、カタカナを使い分けなければならなかった。これには、同社が公開した「Google日本語入力」(後述)の技術を活用した。

音声認識ソフトウェアというと、従来は最初に利用者の声を覚えさせる学習作業が必要だったが、Google音声検索は、以上のような工夫により、特別な準備なしにいきなり話しかけても、正しく認識する確率を高めている。

Google音声検索は、インターネット上のサーバが組み込み機器に提供するサービスともいえる。iPhoneやAndroid以外の機器であっても、音声データを受け取るAPI(Application Programming Interface)をサーバが用意すれば、さまざまな機器から利用できる。APIの公開について井上氏は「まだ検討の段階にも入っていないが、面白いと思う」と、意欲をにじませた。

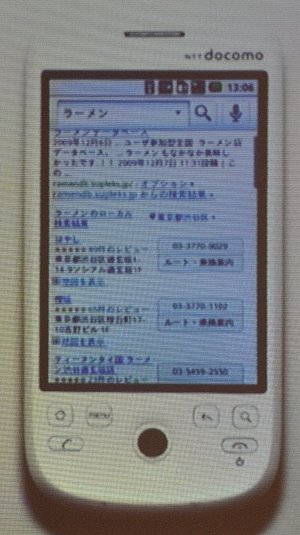

井上氏は「スマートフォンはマイクだけでなく、カメラ、GPSなど、さまざまなセンサーを備えている。マイクに限らず、センサーからの入力をサーバに送信することで、スマートフォンの用途はもっと広がる。サーバがデータ解析した結果を、スマートフォンが備えるスピーカから出力させることも可能だ」と、スマートフォンとサーバクラスタの連携を進めていく考えを示した(図3)。

かな漢字変換ソフトも登場

Google音声検索の登場に先立って、グーグルは2009年12月3日、PC用かな漢字変換ソフト「Google日本語入力」を無償公開している。WindowsとMac OS Xで利用可能。Google音声検索とは異なり、動作時にサーバと連携する必要はないので、インターネットにつながっていない状態でも利用できる。

Google日本語入力の特徴は、グーグルが持つ膨大な言語データベースから生成した辞書を利用している点。連文節変換などの、一般的なかな漢字変換ソフトが備える機能を一通り搭載した上で、独自の辞書を活用する。言葉の入力途中で最終的な結果の候補を提示(サジェスト)する機能も備える。

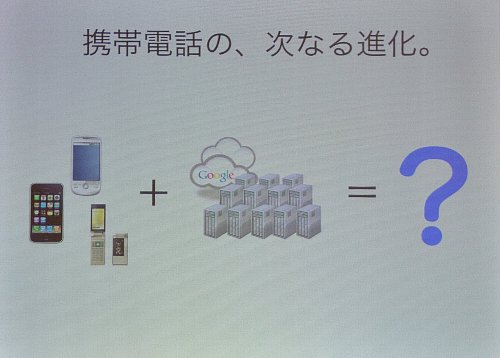

この辞書は、巡回プログラムが集めたWebページのテキストデータなどから自動的に生成する。そのため「人手では到底追い付かないような分野の語いも大量に収録できた」(同社シニア エンジニアリング マネージャを務める及川卓也氏)という。Webのデータから辞書を作っているため、流行語や人名に強い(図4)。

図4 Google日本語入力の変換例 冒頭を見ると、同じ「いっぱつ」でも、前後関係を判断して正しく変換していることが分かる。その後は、人名の変換結果。ここに挙げた変換結果は、どれも入力途中にサジェスト機能で候補が出てきた。

図4 Google日本語入力の変換例 冒頭を見ると、同じ「いっぱつ」でも、前後関係を判断して正しく変換していることが分かる。その後は、人名の変換結果。ここに挙げた変換結果は、どれも入力途中にサジェスト機能で候補が出てきた。Google日本語入力の開発メンバーの1人である同社のソフトウェアエンジニアの工藤拓氏は、ユーザーが誤入力した検索語から正しい検索語を推測する「もしかして」機能の開発者。同氏は、「検索語のデータを見ると変換の誤りが多かった。そして、大体の誤りを『もしかして』で修正できていたので、かな漢字変換ソフトを作れば良いものができると思った」と開発の動機を明かした。

今のところ、Google日本語入力はWindowsとMac OS Xに対応するのみだが、及川氏は米Google社が2010年末に向けて開発中のネットブック向けOS「Chrome OS」には対応させると明言した。時期については、「Chrome OS登場当初はオープンソースのかな漢字変換ソフトを利用するかもしれないが、いずれGoogle日本語入力で代替するようにしていく」とした。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- Raspberry PiがAIカメラモジュール発売へ、ソニーのAI処理機能搭載センサー採用

- 「FinFETの終えん」に備える 今後10年でGAAへの移行が加速?

- 2023年の世界半導体売上高ランキングトップ20、NVIDIAが初の2位に

- ルネサス甲府工場がいよいよ再稼働 柴田社長「パワー半導体の戦略的拠点に」

- 就業人員の4割が帰還組、ルネサス甲府工場が10年の時を経て再稼働

- 2024年はDRAM/NAND市場が回復へ 需給バランスも正常化

- 日本伝統の「和装柄」がヒントに 半導体の高度な熱管理につながる技術

- 半導体製造装置の販売額、2023年は1063億ドルで前年比1.3%減

- 信越化学が国内に新生産拠点、半導体露光材料事業の拡大に向け

- 受託開発の内容を「メニュー」としてサービス化、日立が本格展開

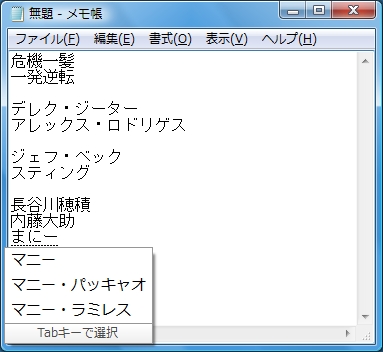

図1 グーグルのアソシエイト プロダクト マネージャを務める井上陸氏 Google音声検索をインストールしたスマートフォンに検索語を話しかけている。

図1 グーグルのアソシエイト プロダクト マネージャを務める井上陸氏 Google音声検索をインストールしたスマートフォンに検索語を話しかけている。 図2 利用者が渋谷にいる状態で「ラーメン」と話しかけて検索した結果 渋谷にあるラーメン店の情報が並んでいる。

図2 利用者が渋谷にいる状態で「ラーメン」と話しかけて検索した結果 渋谷にあるラーメン店の情報が並んでいる。 図3 クラウドと組み合わせることで、スマートフォンだけでは不可能な処理が可能になる 井上氏は、スマートフォンが備える各種センサーの情報をクラウドで利用するアイデアを挙げていた。

図3 クラウドと組み合わせることで、スマートフォンだけでは不可能な処理が可能になる 井上氏は、スマートフォンが備える各種センサーの情報をクラウドで利用するアイデアを挙げていた。