「CES 2020」で感じた10の所感:膨大な取材を終えて(1/4 ページ)

膨大な数の記者会見やインタビューが行われた「CES 2020」。CESでの取材を終えて筆者が感じた「10の所感」をまとめる。

「CES 2020」(2020年1月7〜10日、米国ネバダ州ラスベガス)では、広大な会場に数々の展示ブースが設置され、膨大な数の記者会見や、1対1のインタビューが行われた。CES 2020の厳しい取材を乗り越えると、誰もがほとんど無意識のうちに、重要な情報のリストを入手して帰ってきたことに気付くのではないだろうか。筆者が今回、CES会場で得ることができた主要な認識事項について、以下にまとめていきたい。

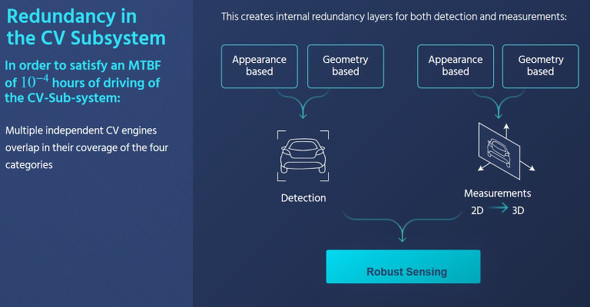

1. カメラのみ搭載の自動運転車は、内部冗長性を確保できるのか

レーダーやライダーの存在は忘れようということなのか。

自動運転車業界の専門家たちは、「自動運転車の安全性確保のために不可欠な冗長性は、複数のセンサー(ビジョン、レーダー、ライダーなど)やデータフュージョンを使用することで実現する」と主張し続けてきた。

Mobileyeのプレジデント兼CEOを務めるAmnon Shashua氏は、CES 2020において行われたIntel/Mobileyeの記者会見で、これまでの常識とは異なる見解を示した。同氏は、「Mobileyeは現在、AI(人工知能)技術の進歩を活用し、複数の独立したコンピュータビジョンエンジン上で、さまざまな種類のニューラルネットワークアルゴリズムを動作させることにより、“内部冗長性”を確保している」と述べている。

例えば同社は、カメラのみを搭載したサブシステムに、6種類の異なるアルゴリズムを適用して、物体検出を実現している。また、4種類のアルゴリズムを適用すれば、2D画像に奥行きを加えることができるため、ライダーを使用しなくても3D画像を効率的に作成することが可能だという。

ただしMobileyeは、自動車業界に対して、レーダーやライダーを排除するよう提案しているわけではない。Shashua氏は、「もし要望があれば、自動車メーカーは、ライダーとレーダーを別のストリームとして組み合わせて使うこともできる」と述べている。

技術顧問サービスを手掛けるVision Systems Intelligence(VSI Labs)の創設者でプリンシパルを務めるPhil Magney氏は、「(どのような形で冗長性を確保するかは)それぞれの顧客企業に委ねられるが、AI技術の進化によって、カメラのみを搭載したサブシステムに一定レベルの冗長性を追加できるようになったという点が新しい」と述べている。

2. ビッグデータのフィルタリング

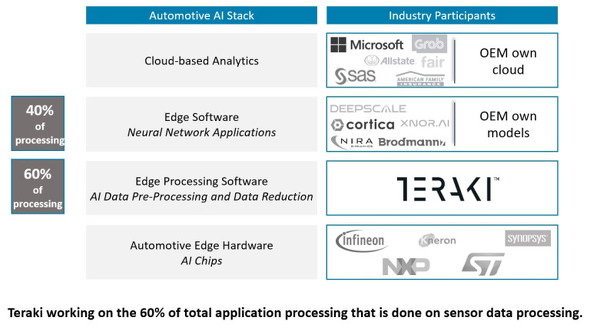

ビッグデータが、コネクテッドデバイスを活性化させる要素であるということに、疑いの余地はない。しかし、さらに重要なのは、どのような方法でビッグデータから質の高い情報を取り出すかという点だ。誰もが悪戦苦闘している課題である。

例として、高性能自動運転車を見てみよう。日に日に増大するセンサーデータ量にも十分対応可能な処理装置は、決して安価ではない。大規模CPU/GPUの放熱量はかなり多く、機械学習のトレーニングのためにビッグデータをクラウドに上げるのはコストがかかる。これらのコストを低減する一つの方法が、エッジにおけるデータのフィルタリングだ。

ドイツのTerakiは、こうした技術を手掛けている企業だ。同社は、機械学習や、より高精度な物体検知のためにデータをフィルタリングしリサイズするソフトウェアを開発している。

Copyright © ITmedia, Inc. All Rights Reserved.

記事ランキング

- 2023年の世界半導体売上高ランキングトップ20、NVIDIAが初の2位に

- 中国政府の「Intel/AMD禁止令」、中国企業への強い追い風に

- 就業人員の4割が帰還組、ルネサス甲府工場が10年の時を経て再稼働

- 日本伝統の「和装柄」がヒントに 半導体の高度な熱管理につながる技術

- ルネサス甲府工場がいよいよ再稼働 柴田社長「パワー半導体の戦略的拠点に」

- JDI、次世代有機ELディスプレイ「eLEAP」を24年12月に量産開始へ

- Raspberry PiがAIカメラモジュール発売へ、ソニーのAI処理機能搭載センサー採用

- 半導体製造装置の販売額、2023年は1063億ドルで前年比1.3%減

- 全固体ナトリウム電池の量産化に向けた新合成プロセスを開発、大阪公立大

- Rapidus、シリコンバレーに新会社設立 AI半導体の顧客開拓を加速

Mobileyeは、カメラのみを使用する自動運転車に向けた開発を進めている 画像:Mobileye

Mobileyeは、カメラのみを使用する自動運転車に向けた開発を進めている 画像:Mobileye Terakiのエコシステム 画像:Teraki

Terakiのエコシステム 画像:Teraki