AIはFPGAのスイートスポット、Xilinxがエッジ推論をデモ:最新ネットワークへの対応が速い(1/2 ページ)

Xilinxは、組み込み技術の国際展示会「embedded world 2019」(2019年2月26~28日、ドイツ・ニュルンベルク)で、自動車や監視カメラなどでの推論、いわゆるエッジデバイスでの推論をイメージしたデモを展示した。

Xilinxは、組み込み技術の国際展示会「embedded world 2019」(2019年2月26~28日、ドイツ・ニュルンベルク)で、自動車や監視カメラなどでの推論、いわゆるエッジデバイスでの推論をイメージしたデモを展示した。

機械学習/深層学習は、学習と推論に分けられるが、Xilinxが注力するのは推論のみである。現在、NVIDIAやIntelなどが開発を加速させ、激しい競争を繰り広げている「AI(人工知能)向けチップ」は、基本的に学習向けである。だが、Barklays Researchなどの調査会社は、今後はエッジでの推論が大きく伸びると予測している。XilinxのArtificial Intelligence and Edge Computingでプロダクトマーケティングディレクターを務めるNick Ni氏は、「当社は、そこを取りに行く」と強調する。

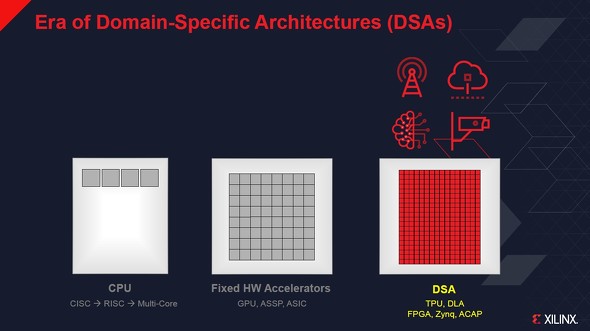

Ni氏は「半導体ICの進化は、デナード則は限界に達し、マルチコア化や、いわゆる『ムーアの法則』も限界が見えている。では、ハードウェアはもう進化できないのか、というと答えはノーだ」と述べる。

ただし、それには新しいアーキテクチャが必要になると多くの専門家が述べている。そこで注目されているのが、DSA(Domain Specific Architecture)だ。これは、異なるワークロードに対して、それぞれ異なるアーキテクチャが必要だ、という考え方である。「だが、何万、何十万というアプリケーションに対して、個別にハードウェアを開発するのは現実的ではない。そこで、プログラマブルなFPGAの強みが生きてくる」(Ni氏)

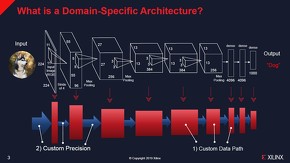

機械学習/深層学習の演算で主にカスタマイズが必要になるのは、データパスと精度(8ビット、4ビットなど)、そしてメモリとの接続である。Ni氏は、「AIのアプリケーションで最も重要なのは、(CNN[Convolutional Neural Network]やRNN[Recurrent Neural Network]などの)ネットワークによってこれら3つを適切に変えていくことだ」と説明する。

ごく単純なクラシフィケーションでも、これだけの演算を行っている。機械学習/深層学習の演算で主にカスタマイズが必要になるのは、図版の1)データパスと2)精度、3)メモリとの接続である 出典:Xilinx(クリックで拡大)

ごく単純なクラシフィケーションでも、これだけの演算を行っている。機械学習/深層学習の演算で主にカスタマイズが必要になるのは、図版の1)データパスと2)精度、3)メモリとの接続である 出典:Xilinx(クリックで拡大)AIのアプリケーションは多岐にわたる上に、AIに使用するネットワークは無数にあり、現在も精度の改善を図りながら増え続けている。「最新のネットワークに追い付くために、NVIDIAやGoogleなどは毎年、新しいチップを発表し続けている」(Ni氏)

「これは、やはり大変なこと。新しいチップを開発するには最低でも2年はかかるし、リスクもある。しかも2年後を予測して開発しなければならない。AIのような、変化が速い市場でそれは難しい。一方でFPGAを使えば、『このネットワークや用途ならば、このハードウェア設計』『これなら、こっちのハードウェア設計』といったように、まったく同じチップで数カ月、もしくは数週間の単位でハードウェア設計を変更することができる。そのため、常に、最新のネットワークに対して最も効率のよい回路を作ることが可能だ」(Ni氏)

Copyright © ITmedia, Inc. All Rights Reserved.

Special Contents

- PR -Special Contents 1

- PR -Special Contents 2

- PR -記事ランキング

- 講演会場が静まり返った――中国が生み出した衝撃のトランジスタ構造

- 「DRAM生産の4割を米国で」 Micronを待ち受ける過酷な競争

- TSMCがGaN事業撤退へ、ロームは「さまざまな可能性を協議」

- TSMCがGaNファウンドリー事業から撤退へ、NavitasはPSMCと提携で対応

- 25年Q1のファウンドリー市場は縮小緩やかも、Samsung/GFは大幅低迷

- 最大の壁、p層を克服!酸化ガリウムでFLOSFIAが達成した「世界初」

- 加速器を用いた「省電力次世代EUV露光技術」開発へ

- 26年度には世界大手の9割が採用、黒字化も 本格化するソニーの車載イメージセンサー

- 「光で剥離」 次世代半導体パッケージの歩留まりと生産性向上へ

- SoC設計期間を「10分未満」に短縮 インドRISC-V新興