CPUのみで高速学習、組み込みAIを低コストで実現:GPU不要の環境で使える

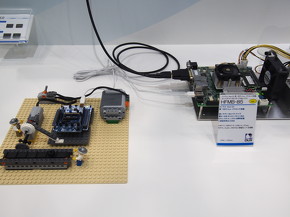

ディープインサイトは、「第8回IoT/M2M展」で、IntelのCPUのみで学習を行うデモを展示した。ディープインサイトが開発しているディープラーニング用フレームワーク「KAIBER(カイバー)」の学習エンジンをCPU向けに最適化し、GPUを使わない環境で高速に学習できるようにしている。

ディープインサイトは、「第8回IoT/M2M展」で、IntelのCPUのみで学習を行うデモを展示した。ディープインサイトが開発しているディープラーニング用フレームワーク「KAIBER(カイバー)」の学習エンジンをCPU向けに最適化し、GPUを使わない環境で高速に学習できるようにしている。

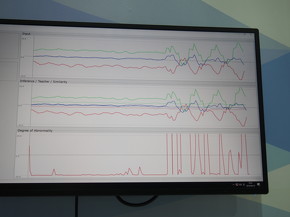

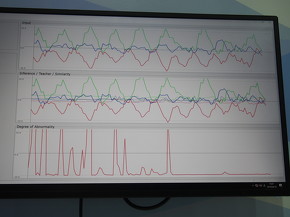

デモでは、高速で回転する歯車の模型に加速度センサーを取り付け、振動を計測。高速回転する歯車の上に障害物を置くと、波形(振動のデータ)が乱れ、推論を行って「異常」と判断する。だが、乱れた波形が何秒間か続くと、システムがそれを学習し、「正常」と判断するようになる。つまり、そのくらい素早く学習しているということだ。ディープインサイトのCEOを務める久保田良則氏は、「実際のアプリケーションに応用するときには、異常な波形が一定時間続いたら学習をやめてアラートを出す、という使い方にする必要がある」と説明する。

左=グラフの上2段が振動波形で、一番下は、異常度を表す波形。直線の波形は「正常」で、大きく振れた状態は「異常」を示している。歯車の回転を邪魔すると、振動波形が乱れ、「異常」と判断される/右=乱れた波形が続くと、それを正常だと学習するので、一番下のグラフが直線に戻っている(クリックで拡大)

左=グラフの上2段が振動波形で、一番下は、異常度を表す波形。直線の波形は「正常」で、大きく振れた状態は「異常」を示している。歯車の回転を邪魔すると、振動波形が乱れ、「異常」と判断される/右=乱れた波形が続くと、それを正常だと学習するので、一番下のグラフが直線に戻っている(クリックで拡大)同技術は、ロボットや産業機器、IoT(モノのインターネット)ゲートウェイなどに搭載することを想定している。久保田氏は、製造現場の装置、つまりエッジデバイスで学習できるようにしたいというニーズは高まっていると話す。「製造現場は、1つ1つの工場や製造ラインによって、環境がかなり異なる場合がある。異常な波形などを事前に学習し、それを現場で実装すると、推論の精度にブレが生じる可能性が高い。1つ1つの現場で、リアルタイムに学習すれば、精度のブレが少ない推論ができるようになると考えている」(久保田氏)

KAIBERの学習エンジンは本来はGPUを使うが、今回はそれを、Intelの「Xeon E3」向けに最適化した。久保田氏によると、最適化の方法としては、「CPUのコアを指定し、それらのコアだけを学習用に使う」ことも可能だという。

今回の技術は、まだ最適化する余地はあるものの、技術的には確立されているという。「ドキュメントなどが整えば、2019年夏ごろまでにはリリースできる予定だ」(久保田氏)

Copyright © ITmedia, Inc. All Rights Reserved.

Special Contents

- PR -- EE Times Japanテ勇DN Japan 邨ア蜷磯崕蟄千沿�� 蜊雁ー惹ス捺・ュ逡� 縺薙l縺セ縺ァ縺ョ20蟷エ縲√%繧後°繧峨�20蟷エ窶補� 髮サ蟄千沿2025蟷エ6譛亥捷

- 繧「繝励Μ繧ア繝シ繧キ繝ァ繝ウ縺ョ隕∽サカ縺ォ蠢懊§縲√す繧ー繝翫Ν繝√ぉ繝シ繝ウ縺ョ豸郁イサ髮サ蜉帙r蜑頑ク帙☆繧区婿豕�

- 菴取カ郁イサ髮サ蜉幢シ城ォ倡イセ蠎ヲ縺ョ繧キ繧ー繝翫Ν繝√ぉ繝シ繝ウ縲∵ウィ諢上r謇輔≧縺ケ縺阪ち繧、繝溘Φ繧ー隕∝屏縺ィ縺ッ��

- Intel縲∽サ翫←縺�↑縺」縺ヲ繧具シ溘闍ヲ蠅�r謚懊¢蜃コ縺帙k縺�

- 繝代Ρ繝シ蜊雁ー惹ス薙〒豕ィ逶ョ縺ョGaN縲√ヱ繝ッ繝シ繧「繝ウ繝励ユ繧ケ繝医�隱イ鬘後→譛驕ゥ縺ェ繧「繝励Ο繝シ繝�

Special Contents 1

- PR -記事ランキング

- 「Switch 2」を分解 NVIDIAのプロセッサは温存されていた?

- ルネサスがWolfspeedの再建支援、Q2には2500億円の減損か

- DRAM業界をかき乱す中国勢、DDR4の供給の行方は?

- 「N2」SRAMの歩留まりは90%以上 技術開発も好調のTSMC

- コンチネンタルが半導体を自社開発へ、製造はGF

- TELとimecが「戦略的パートナーシップ」を5年延長

- 「Rapidusを支援したい」 VCに転身のPat Gelsinger氏、日米の協業に意欲

- 全固体電池の容量劣化メカニズム マクセルが解明

- 京大やトヨタなど、全固体フッ化物イオン二次電池用正極材料を開発

- 2nm半導体設計基盤でRapidusとシーメンスが協業

組み込みに特化した商用の深層学習フレームワーク

組み込みに特化した商用の深層学習フレームワーク 2019年も大注目! 出そろい始めた「エッジAIプロセッサ」の現在地とこれから

2019年も大注目! 出そろい始めた「エッジAIプロセッサ」の現在地とこれから NVIDIAが解説するディープラーニングの基礎(前編)

NVIDIAが解説するディープラーニングの基礎(前編) AIの開発、半導体業界にとってますます重要に

AIの開発、半導体業界にとってますます重要に 5Gも機械学習も「ArmプロセッサIP」で全部やる

5Gも機械学習も「ArmプロセッサIP」で全部やる Arm MLプロセッサ、明らかになったその中身

Arm MLプロセッサ、明らかになったその中身